-

企業安全大模型安全解決方案

隨著大模型邁入2.0階段,各企業在借助大模型提升生產力的同時也伴隨嚴峻的安全挑戰。數據顯示,2024年全球大模型相關漏洞數量激增38.61%,對抗攻擊、數據泄露等風險頻發。政策層面,《生成式AI服務管理暫行辦法》等法規密集落地,要求企業構建覆蓋數據、模型、應用的全生命周期安全體系 。通過事前檢測評估、事中運行防護對企業大模型安全知識庫建設及備案上線,運行時抵御網絡入侵并確保輸出內容合規及安全,助力企業在大模型2.0時代高效數字化發展。

-

-

-

-

大模型應用服務被攻擊

大模型應用服務存在漏洞、弱口令等脆弱性風險,可能被病毒入侵、網絡攻擊等造成服務異常,嚴重的還可能因為投毒改變模型本體能力。

-

-

-

-

RAG語料導致數據泄露

在微調、訓練及構建知識庫中未識別敏感信息進行清洗,導致企業機密與用戶隱私外泄,如醫療病歷、金融交易記錄等。

-

-

-

-

模型輸出內容風險

生成內容存在違反社會主義核心價值觀、事實性錯誤或偏見等誤導用戶決策,引發輿情危機(如虛假政策解讀),也不滿足《生成式AI服務管理暫行辦法》等法規。

-

-

-

-

使用失管及不安全輸出

違規使用大模型應用或缺乏本地數據訪問控制造成商業秘密泄露,被大模型生成的釣魚信息、惡意代碼等入侵企業網絡。

-

-

-

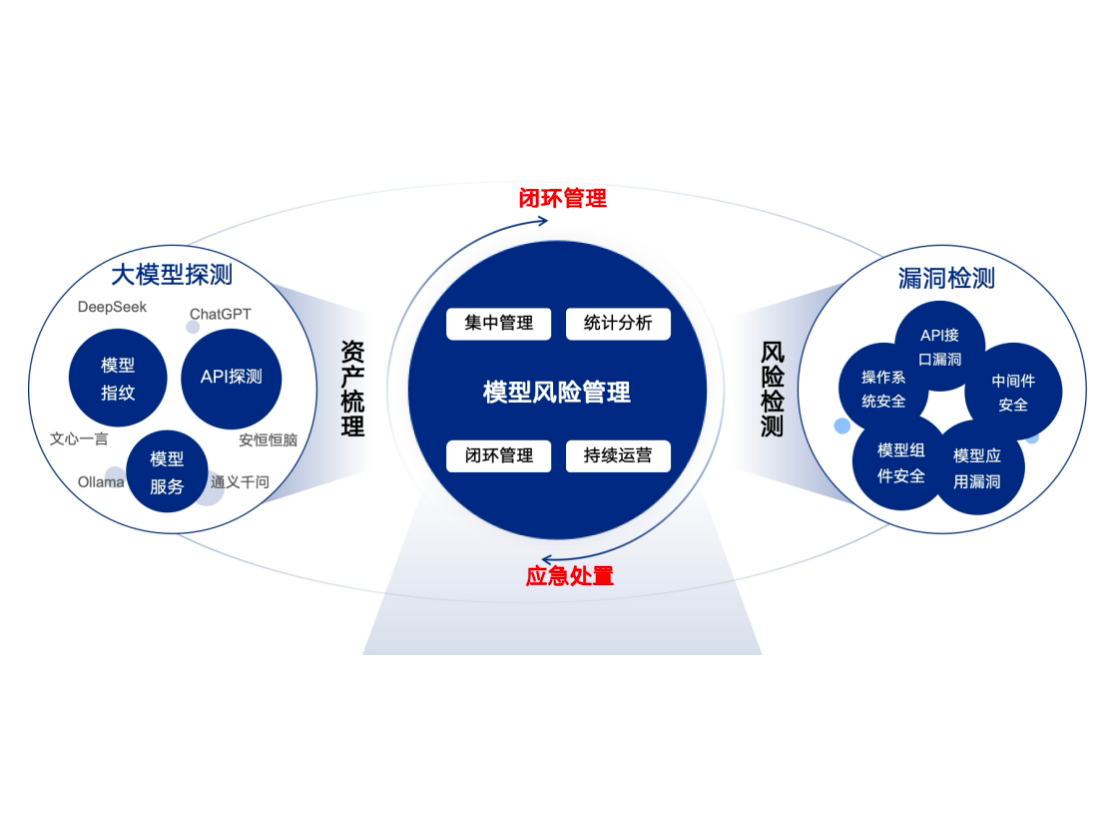

大模型風險檢測與閉環

多維度風險探測引擎及閉環處置機制,保障大模型底層系統、中間件、應用組件及語料數據的安全性,覆蓋漏洞檢測、敏感信息識別等關鍵環節,實現AI系統全生命周期安全檢查。

-

-

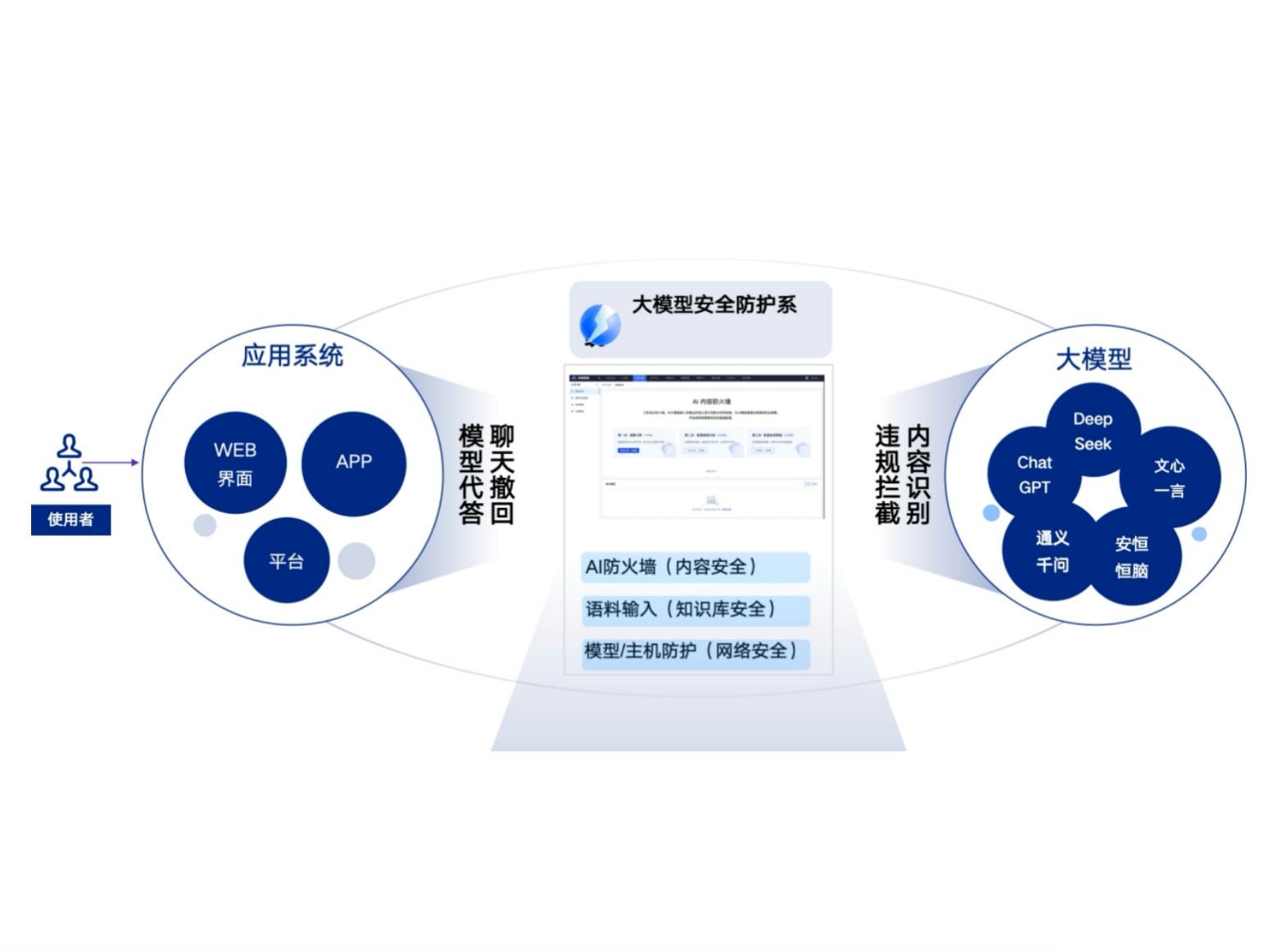

大模型安全防護

為大模型資產提供全鏈路的安全防護,從語料輸入到模型輸出,再到事后審計封禁,實現主機安全、語料輸入安全、模型資產安全以及內容安全防護。

-

-

AI辦公安全助手

專注辦公場景下 AI 應用安全,對 AI 應用資產、資源訪問控制、AI敏感信息保護等多方提供安全應用保障,構筑AI應用安全防線。

- 訓練數據保護

- 大模型服務備案

- 大模型使用管控

- 生成內容合規管理

- 輸入數據防泄漏

- 主機安全實時防護

-

-

場景描述:

語料庫未分級分類,開發人員可能誤用含敏感信息的數據集。

場景方案:

在大模型微調、訓練、構建知識庫前,對數據進行掃描檢測識別敏感信息,并對數據進行分類分級或清洗脫敏,防止敏感信息進入大模型。

-

-

場景描述:

企業需通過網信辦備案審查,但線下流程耗時3個月以上,技術整改難度大。

場景方案:

為大模型服務商提供內容安全合規改造咨詢服務,圍繞《生成式人工智能管理辦法》合規要求,協助企業快速完成大模型相關內容安全建設,快速大模型完成測評備案工作。

-

-

場景描述:

大模型使用失管可能造成數據泄露或非授權使用。

場景方案:

根據實際業務及安全性考慮,對不同終端訪問多個大模型服務進行訪問權限策略控制,并審計相應的大模型使用記錄,確保企業內安全可控的大模型使用。

-

-

場景描述:

模型輸出可能包含意識形態偏差、暴力色情等違規內容,需實時檢測阻斷。

場景方案:

在輸入階段對提示詞進行評估,防止生成非法結果;在輸出階段對模型生成的內容進行違規檢測,及時阻斷非法內容輸出和事后審計。

-

-

場景描述:

用戶模型輸入時可能上傳身份證、薪資等敏感數據,導致隱私泄露。

場景方案:

在輸入時對內容、附件進行敏感信息識別,當發現含敏時進行脫敏或攔截處理,確保大模型不吃敏。

-

-

場景描述:

模型服務器存在弱口令、未修復漏洞,易被入侵植入惡意代碼或竊取訓練數據。

場景方案:

從主機漏洞、病毒、黑客入侵、網絡訪問控制等方面進行實時的入侵檢測與防護,確保大模型主機運行環境安全,抵御網絡入侵攻擊。

AI+安全

AI+安全 數據安全

數據安全 數據基礎設施

數據基礎設施 態勢感知

態勢感知 云安全

云安全 基礎安全

基礎安全 終端安全

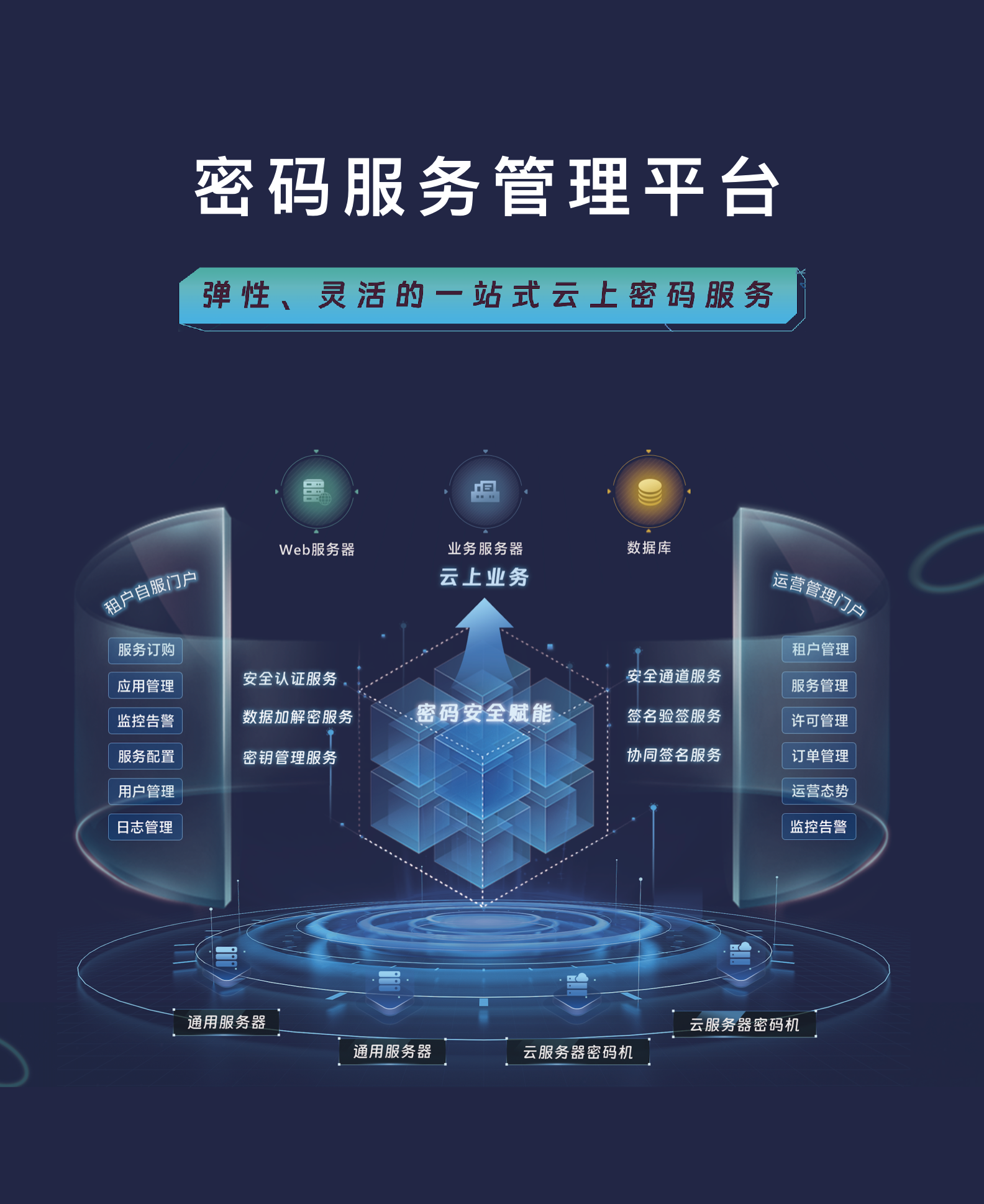

終端安全 商用密碼

商用密碼 軟件供應鏈安全

軟件供應鏈安全 網絡空間靶場

網絡空間靶場 工業互聯網安全

工業互聯網安全 物聯網安全

物聯網安全

安全托管服務

安全托管服務 運營管理服務

運營管理服務